清华新闻网11月10日电 随着大模型等人工智能技术的突破与发展,算法复杂度剧增,对传统计算芯片带来了算力和功耗的双重挑战。近年来,以光计算为基础、通过光电融合的方式构建光电神经网络的计算处理方法已经成为国际热点研究问题,有望实现计算性能的颠覆性提升。然而,光电神经网络的前向数学模型由对光场的精准物理建模得到,计算复杂度高、参数冗余度大;其学习机制沿用人工神经网络常用的梯度下降算法,面向大规模光电神经网络时优化速度慢、资源消耗高、收敛效果差。因此,现有学习架构仅能支撑小规模光电神经网络的训练,其网络容量和特征捕获能力不足以有效处理ImageNet等大型复杂数据集。

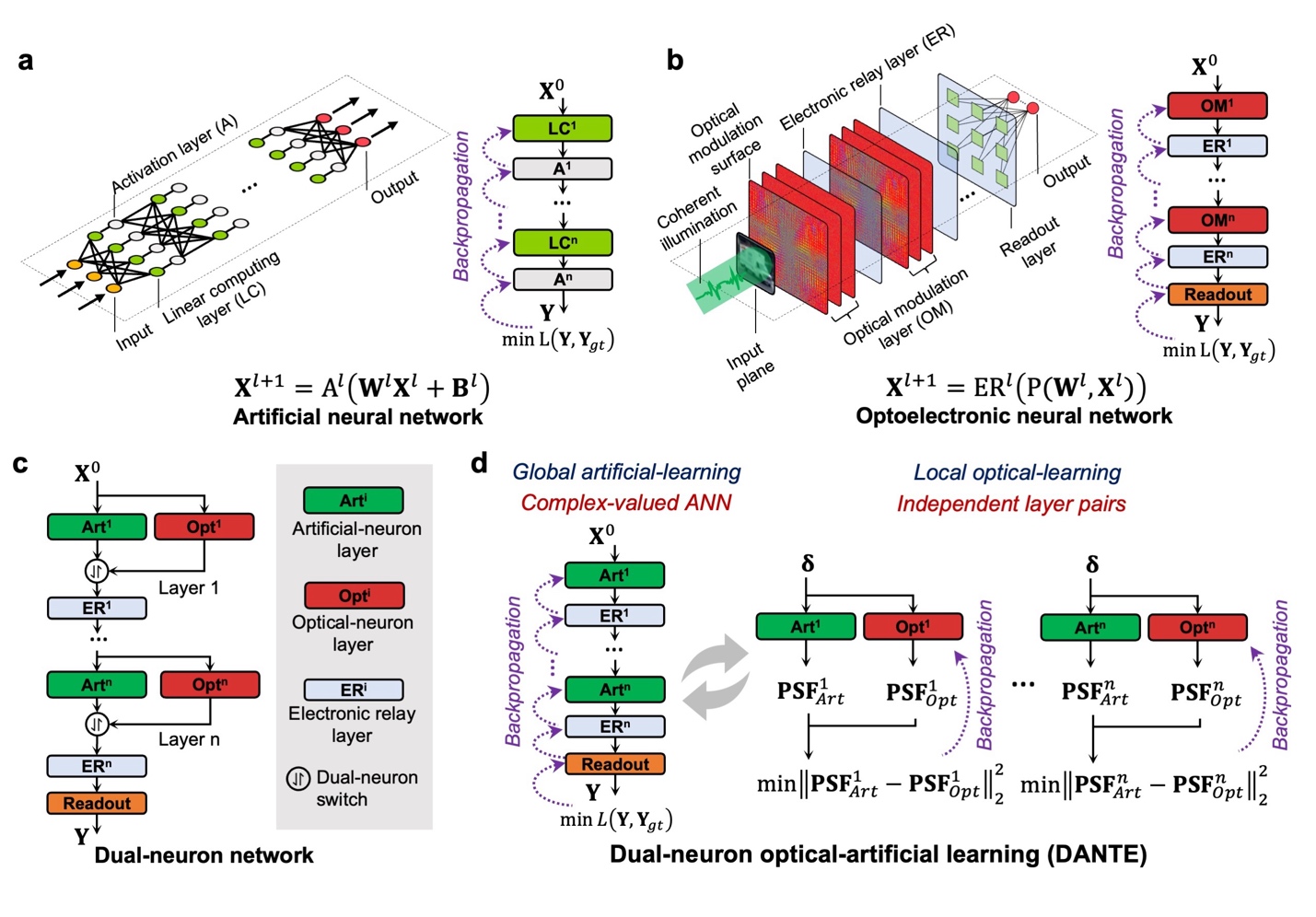

近日,清华大学电子工程系方璐副教授课题组提出了面向大规模光电智能计算的“光学-人工双神经元学习架构(DuAl-Neuron opTical-artificial lEarning,DANTE)”。其中光学神经元精准建模光场计算过程,人工神经元以轻量映射函数建立跳跃连接助力梯度传播,全局人工神经元与局部光学神经元以交替学习的机制进行迭代优化,在确保学习有效性的同时,大大降低了训练的时空复杂度,使得训练更大更深的光电神经网络成为可能。DANTE突破了大规模光电神经网络物理建模复杂、参数优化困难等桎梏,网络规模提升一至两个数量级,训练学习速度提升两个数量级。

图1.光学-人工双神经元学习架构(DANTE)

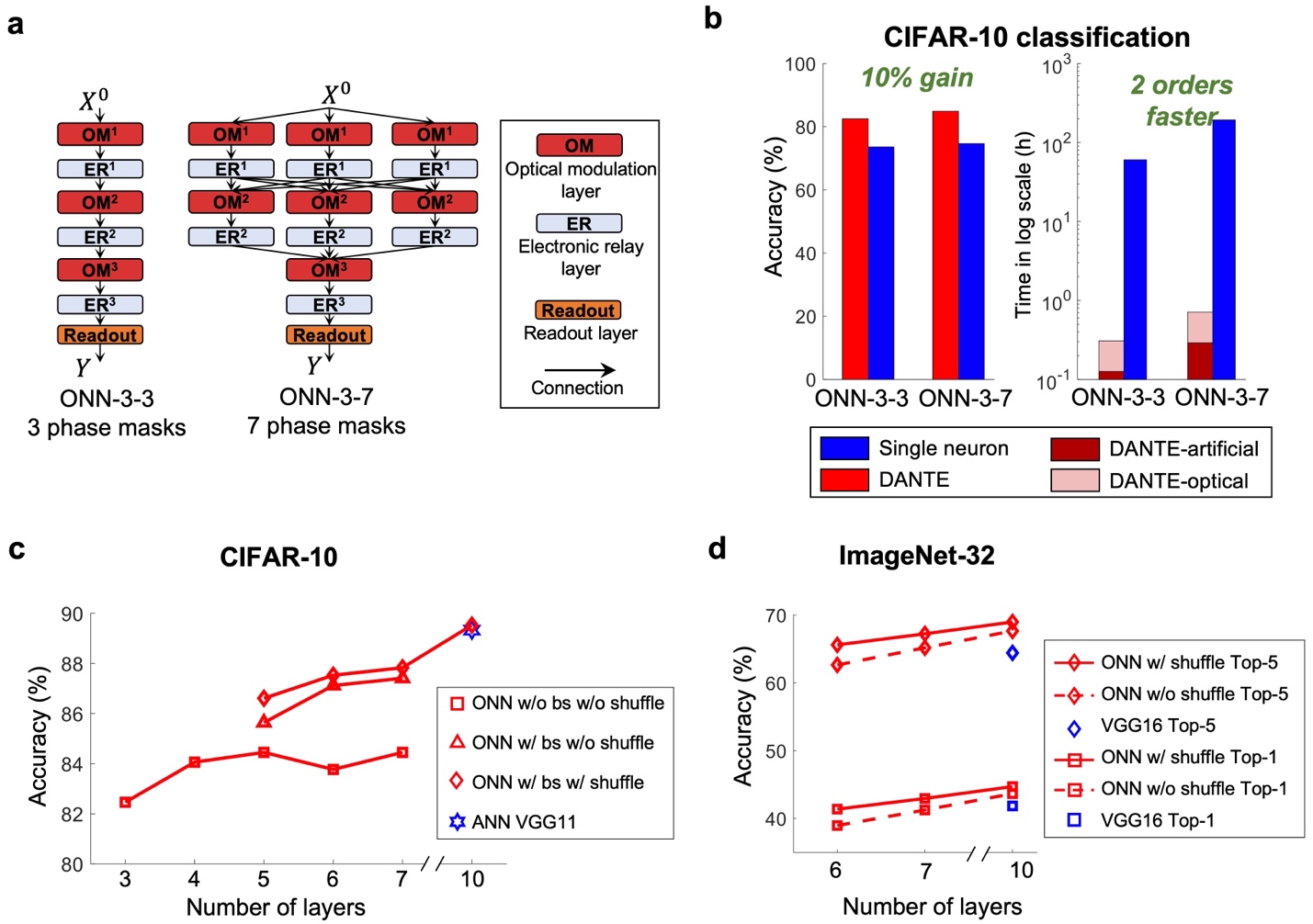

受限于算力瓶颈与显存容量,现有的单神经元学习方法仅能实现百万量级神经元的光电神经网络训练,难以满足ImageNet等复杂大规模数据集的训练需求。课题组在空间光智能计算平台上开展了大量仿真与物理实验验证,将现有百万量级光电神经元网络的训练时间从数十小时级缩短到了分钟级。课题组进一步基于DANTE,首次实现了亿级神经元的大规模光电神经网络训练与推理,在CIFAR-10、ImageNet等多个数据集上实现了与经典人工神经网络VGG-11和VGG-16相当的准确率。值得强调的是,在ImageNet基准上成功训练光电神经网络具有重要意义。这展现了DANTE在支撑大规模光电神经网络训练学习上的巨大潜力,有望推动光电智能计算从基于MNIST基准的原型验证阶段迈入到使用现代ImageNet基准来解决大规模现实问题的全新时代。

图2.DANTE在CIFAR-10和ImageNet数据集上的训练与推理性能评测

研究成果以“光学-人工双神经元架构训练大规模光电神经网络”(Training large-scale optoelectronic neural networks with dual-neuron optical-artificial learning)为题,于11月4日发表于《自然·通讯》(Nature Communications)期刊上。

清华大学电子工程系为论文的第一单位,方璐副教授为论文通讯作者,电子系博士后袁肖赟(清华大学水木学者、已出站)为论文第一作者,参加研究的作者还包括课题组博士生王勇(已毕业)、徐智昊,博士后周天贶。

该研究课题得到科技部科技创新2030—“新一代人工智能”重大项目,基础科学中心项目、面上项目,清华大学水木学者计划等的支持。

论文链接:

https://doi.org/10.1038/s41467-023-42984-y

供稿:电子系

题图设计:李柳依

编辑:李华山

审核:郭玲